Das Problem mit der Gesichtserkennung anhand von PopID

Bezahlen und ausweisen per Gesichtsscan: Was vielleicht bequem klingen mag, birgt zahlreiche Risiken. Das zeigt sich abermals beim US-amerikanischen Tech-Startup PopID. Nicht nur, weil der Datenschutz nicht gewährleistet ist, sondern auch, weil die KI rassistisch – oder zumindest vorurteilend – sein könnte.

PopID: Das Gesicht als Verifizierungsmerkmal

In Zeiten von möglichst wenig physischem Kontakt drängen neue Lösungen auf den Markt, die „alte“ Verifizierungen ersetzen sollen. Soll heißen: Wo früher noch ein Fingerabdruck zum Einlass notwendig war, reicht es nun, das Gesicht in die Kamera zu halten. Und statt dem Auflegen der Bankomatkarte grinst man einfach kurz in die PopID-Geräte. Das Startup hat vor kurzem ein Netzwerk für gesichtsbasierte Zahlungen mit 25 Restaurants und Einzelhändlern im kalifornischen Pasadena ins Leben gerufen.

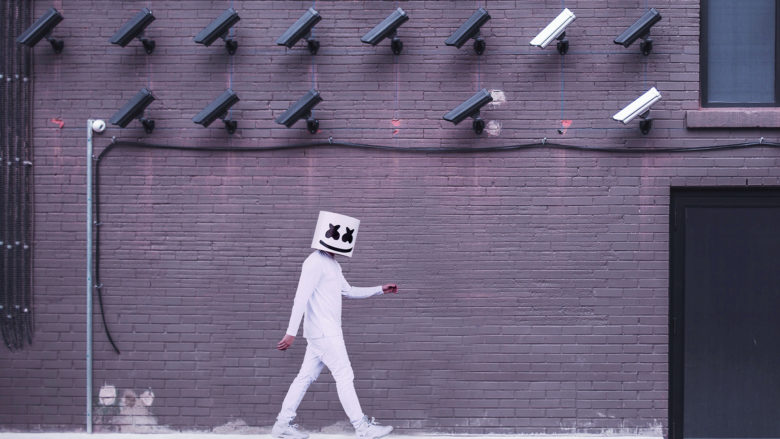

PopID bietet zudem ein Produkt namens „PopEntry“ an, das die Identität von Personen an Geschäftsorten und Universitäten überprüft. CEO John Miller behauptete gegenüber Venturebeat, dass bereits über 1.000 PopEntry-Einheiten verkauft worden seien und dass mehrere tausend weitere Einheiten bis Ende 2020 in Colorado, Texas, Arizona und Indiana installiert werden sollen.

„Ultrasicherer digitaler Token“

Die Idee hinter dem System ist vergleichsweise simpel: Um sich bei PopID anzumelden, besuchen Kunden die gleichnamige Webseite und machen ein Foto von sich. Wenn sie nun das nächste Mal mit in einem Partnergeschäft oder einer Partnerschule sind, können sie ihr Gesicht zur Verifizierung verwenden, indem sie sich vor eine Kamera stellen. „Ihr Gesicht wird nun Ihr einzigartiger, ultra-sicherer ‚digitaler Token‘ für alle PopID-Transaktionen und -Geräte […]“, heißt es auf der Webseite des Unternehmens.

Drei große Probleme

So interessant die Idee auch klingen mag, Venturebeat führt einige Schwierigkeiten an, die langfristig zum Problem werden könnten. Das erste: „Bias“. Vereinfacht ausgedrückt: Auch künstliche Intelligenzen können zu Vorurteilen neigen. Das ist auch logisch, immerhin werden sie nach wie vor von Menschen programmiert. Der Algorithmus, auf den PopID setzt, stammt vom japanischen Elektronikkonzern NEC, der schon länger in der Kritik steht. Zwar verwehrt sich PopID sämtlicher Vorwürfe, das die KI Menschen nach gewissen Merkmalen klassifizieren würde – überprüfbar ist das letztlich aber kaum.

Dazu kommt eine recht einhellige Expertenmeinung, wonach Ungleichgewichte in Daten und Systemen die Beseitigung algorithmischer Verzerrungen nahezu unmöglich machen. Zu sehen war das beispielsweise vor einigen Jahren, als der Algorithmus von Google Photos schwarze Menschen als „Gorillas“ bezeichnete. In einem anderen Fall bezeichnete Googles Cloud Vision API ein von einer dunkelhäutigen Person gehaltenes Thermometer automatisch als „Pistole“ , während es ein von einer hellhäutigen Person gehaltenes Thermometer als „elektronisches Gerät“ erkannte.

Thema Datennutzung

Das zweite Problem: Die Herrschaft über die Daten. Laut Miller ist die PopID-Plattform insofern ein Opt-in-System, als dass sich die Benutzer für die Registrierung entscheiden müssen und das System den biometrischen Abgleich nur in bestimmten Situationen und an bestimmten Orten durchführen würde. Die Datenbank, in der die Fotos der Gesichter abgelegt sind, sei zudem sowohl im passiven Zustand als auch während er Übertragung verschlüsselt. Auch NEC solle keinen Zugang zu den Daten haben und Kunden hätten die Möglichkeit, die Löschung ihrer Daten zu verlangen.

Allerdings: PopID behält sich das Recht vor, persönliche Daten an „Unternehmen weiterzugeben, die PopID zur Authentifizierung der Identität verwenden möchten“. Und wenn Benutzer nicht ausdrücklich die Löschung oder eingeschränkte Offenlegung ihrer Informationen verlangen, speichert PopID die Daten für drei Jahre ab dem letzten Verwendungsdatum.

Sicherheit nicht gewährleistet

Drittens: Sicherheit und Privatsphäre. Das banalste Beispiel: Jemand hält einfach ein Foto eines PopID-Kunden in die Kamera – und erhält so Zugang. Laut PopID obliege es den Mitarbeiten der Partnerbetriebe, Kunden zu stellen, die Bilder von jemand anderem in die Kamera halten. Das bedeutet aber auch, dass erst recht wieder eine menschliche Überwachung notwendig wäre. Dazu kommt ein nie auszuschießendes Risiko, dass das System schlichtweg gehackt wird. Auch dann sind sensible Daten in Gefahr.

Viele Herausforderungen

Zusammengefasst zeigt sich an diesem Beispiel abermals das große Problem rund um die Gesichtserkennung. Wenig verwunderlich, dass große Player wie IBM oder Microsoft laut Venturebeat zuletzt weniger stark auf derartige Produkte und Geräte setzen. Letztlich ist es kaum auszuschließen, dass die sensiblen Bilddaten tatsächlich nur für ihren vorgesehen Zweck eingesetzt werden. Dazu kommt die Unklarheit, wie die KI eigentlich urteilt und verifiziert. So gut die Absichten von PopID also auch sein mögen, bleibt die Gesichtserkennung weltweit ein heikles Thema.

+++Gesichtserkennung: Rückbau einer diskriminierenden Überwachungstechnologie beginnt+++